如果您正在使用Keras库并且想要使用tensorboard打印准确性和其他变量的图,那么下面是要遵循的步骤。

步骤1:使用以下命令初始化keras回调库以导入张量板

from keras.callbacks import TensorBoard

第2步:在“ model.fit()”命令之前,在程序中包含以下命令。

tensor_board = TensorBoard(log_dir='./Graph', histogram_freq=0, write_graph=True, write_images=True)

注意:使用“ ./graph”。它将在您当前的工作目录中生成graph文件夹,避免使用“ / graph”。

步骤3:在“ model.fit()”中包含Tensorboard回调。示例如下。

model.fit(X_train,y_train, batch_size=batch_size, epochs=nb_epoch, verbose=1, validation_split=0.2,callbacks=[tensor_board])

步骤4:运行代码,并检查工作目录中是否存在图形文件夹。如果以上代码正常工作,您的工作目录中将包含“ Graph”文件夹。

步骤5:在工作目录中打开Terminal,然后输入以下命令。

tensorboard --logdir ./Graph

步骤6:现在打开您的Web浏览器并在下面输入地址。

http://localhost:6006

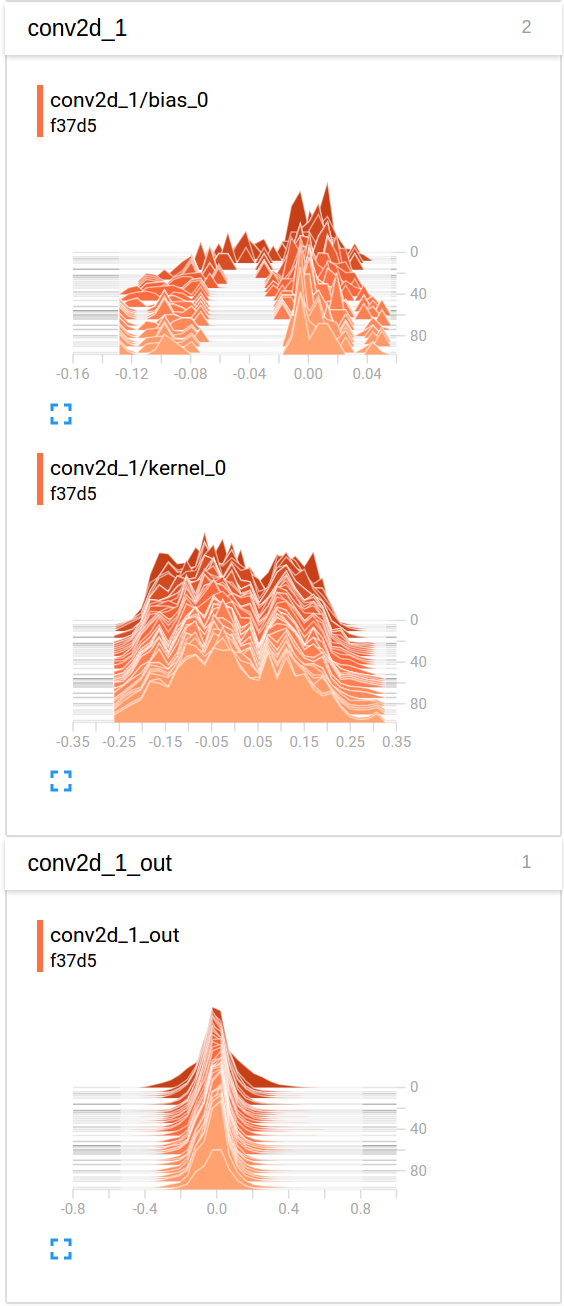

输入后,将打开Tensorbaord页面,您可以在其中查看不同变量的图形。

histogram_freq为1。“ histogram_freq:计算模型各层的激活直方图的频率(以时间为单位)。如果设置为0,将不计算直方图。”